GPT-4 Turbo avec contexte 128K !! Modèles AI et Produits pour Développeurs lors du DevDay d'OpenAI

Les Annonces d'OpenAI Établissent de Nouveaux Standards pour les Développeurs 📢✨ Le DevDay chez OpenAI a été rempli de révélations captivantes. Les développeurs du monde entier se sont vus présenter un trésor de nouvelles fonctionnalités, de capacités améliorées et de réductions de prix significatives sur la plateforme. Parmi les points forts figuraient notamment :

- La capacité améliorée et l'accessibilité de GPT-4 Turbo, ainsi que son support pour une fenêtre contextuelle de 128k.

- Le lancement de l'API Assistants - un grand pas en avant pour aider les développeurs d'applications AI.

- Les capacités multimodales étendues de la plateforme comprenant désormais la vision, la création d'images avec DALL·E 3, et la synthèse de la parole (TTS).

GPT-4 Turbo avec 128K Contexte : Une Nouvelle Ère de Capacité et Accessibilité 🚀💸

Suite au succès du lancement de la première version de GPT-4, OpenAI lance maintenant un aperçu du modèle générationnel suivant, GPT-4 Turbo. Ce modèle est conçu pour offrir des performances supérieures à un coût inférieur et peut gérer un contexte équivalent à plus de 300 pages dans une seule sollicitation grâce à sa vaste fenêtre contextuelle de 128k.

Mises à Jour de l'Appel de Fonction : Rationalisation de l'Intégration de l'AI 🔄🔀

L'appel de fonction subira plusieurs améliorations, notamment la capacité pour des appels de fonction multiples dans un seul message, éliminant ainsi le besoin de multiples interactions avec le modèle.

Suivi d'Instructions Amélioré et Mode JSON ✔📁

GPT-4 Turbo est significativement meilleur pour suivre les instructions méticuleusement, permettant ainsi la génération de formats spécifiques avec facilité. Il introduit également un nouveau mode JSON garantissant des réponses JSON valides du modèle.

Obtention de Sorties Reproductibles et Probabilités de Journal 🔁📊

Le paramètre de graine assure la plupart du temps que le modèle génère des sorties reproductibles, un atout pour le débogage, les tests unitaires et le maintien du contrôle sur le comportement du modèle.

Dévoilement de GPT-3.5 Turbo Mis à Jour 🔄📈

Une nouvelle version de GPT-3.5 Turbo est lancée avec une fenêtre contextuelle par défaut de 16K, un suivi d'instructions amélioré, un mode JSON et un appel de fonction parallèle.

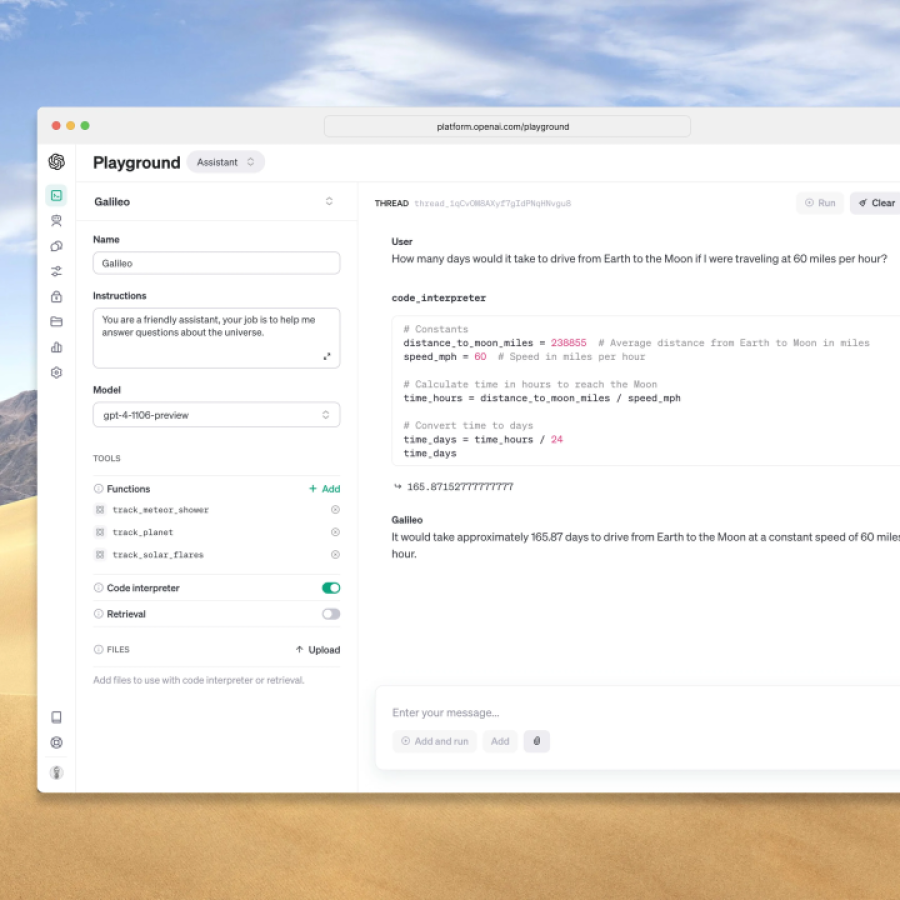

API Assistants : Donner du Pouvoir aux Développeurs pour Créer des Applications AI Innovantes 👨💻🆕

L'API Assistants aide les développeurs à créer des expériences de type agent avec accès à l'Interprète de Code, la Récupération et l'appel de fonction.

Modalités Supplémentaires : Vision, Création d'Images et Texte à Parole 👁🎨🗣

GPT-4 Turbo accepte désormais les images en entrée, permettant des applications uniques comme la génération de légendes. DALL·E 3, capable de générer des images de manière programmable, a été directement intégré dans l'API OpenAI. L'API de synthèse de la parole offre aux développeurs un accès à une synthèse de la parole de qualité humaine.

Baisse des Prix et Augmentation des Limites de Taux 💵⏱

Pour rendre la plateforme plus accessible et conviviale, plusieurs prix sur la plateforme ont été réduits. De plus, la limite de jetons par minute pour tous les clients payants de GPT-4 a été doublée pour permettre de mettre à l'échelle les applications.

💡💼 Le DevDay d'OpenAI a été un jalon dans le domaine du développement de l'AI en introduisant une gamme d'outils, d'améliorations et de mesures économiques pour augmenter les capacités des développeurs d'AI à l'échelle mondiale. Les améliorations des capacités multimodales, l'introduction de l'API Assistant et la baisse des prix témoignent de l'engagement d'OpenAI à faire progresser le domaine du développement de l'AI.

Accès Expérimental à l'Ajustement Fin de GPT-4 et Modèles Personnalisés

OpenAI s'aventure dans un territoire inexploré en introduisant un accès expérimental à l'ajustement fin de GPT-4. Bien que les résultats préliminaires montrent que les avancées dans l'ajustement fin de GPT-4 ne sont pas aussi substantielles qu'avec GPT-3.5, la qualité et la sécurité de l'ajustement fin de GPT-4 seront grandement améliorées alors que l'accent est mis sur des améliorations significatives. En parallèle, OpenAI lance un programme de Modèles Personnalisés visant spécifiquement les organisations avec d'énormes ensembles de données propriétaires - un minimum de milliards de jetons.

Whisper v3 et Décodeur de Cohérence

Dans le cadre de ses initiatives open-source, OpenAI lance Whisper large-v3, une version améliorée du modèle de reconnaissance automatique de la parole (ASR). Ce nouveau modèle offre de meilleures performances dans différentes langues. De plus, OpenAI prévoit de prendre en charge Whisper v3 dans son API prochainement. À la suite de cette publication, OpenAI publie également en open-source le Décodeur de Cohérence, un remplacement précieux pour le décodeur Stable Diffusion VAE, destiné à améliorer la qualité de la génération d'images.

Protection des Droits d'Auteur

Comprenant l'importance de protéger les intérêts de leurs clients, OpenAI a introduit le Bouclier de Droits d'Auteur. Cette offre novatrice par OpenAI défendra et couvrira les coûts pour ses clients s'ils sont confrontés à des revendications juridiques concernant des infractions au droit d'auteur. La mesure couvre toutes les fonctionnalités généralement disponibles de ChatGPT Enterprise ainsi que de la plateforme des développeurs.

Révolutionner l'Écosystème de l'AI

Le DevDay d'OpenAI a été un phare de promesse pour l'avenir de l'AI. En dévoilant des fonctionnalités révolutionnaires telles que l'API Assistants, GPT-4 Turbo et les capacités multimodales, tout en tenant compte des aspects cruciaux des intérêts des clients et de l'accessibilité, OpenAI a établi un nouveau standard dans le paysage en évolution de l'AI. Les améliorations à venir et les déploiements anticipés ne manqueront pas de maintenir les développeurs, les passionnés de l'AI et les entreprises impatients de découvrir le prochain grand pas d'OpenAI dans le domaine de l'AI.

Vous voulez essayer ? essayez-le maintenant !

Source : https://openai.com/blog/new-models-and-developer-products-announced-at-devday

Comments (0)